Establecer el primer estándar mundial en inteligencia artificial generativa

-

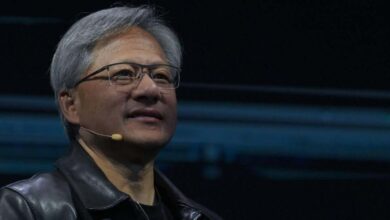

Empresas chinas como Baidu y Tencent, y estadounidenses como NVIDIA y OpenAI, colaboran juntas

-

Se han creado dos estándares enfocados en la seguridad de la inteligencia artificial (IA) generativa y los grandes modelos de lenguaje

A pesar de las tensiones geopolíticas y geoestratégicas entre los gobiernos de Estados Unidos y China, las empresas de ambos países a menudo colaboran en función de sus propios intereses. Por ejemplo, NVIDIA se beneficia de vender sus unidades de procesamiento gráfico (GPU) para inteligencia artificial (IA) en el amplio mercado chino.

ASML, el fabricante holandés de equipos de litografía de vanguardia, también se encuentra en una situación similar. Las restricciones gubernamentales impiden que estas compañías vendan algunos de sus productos más avanzados en China debido a preocupaciones sobre su uso en el desarrollo de capacidades militares. Sin embargo, ocasionalmente, empresas estadounidenses y chinas demuestran su capacidad para trabajar juntas más allá de las disputas gubernamentales.

Estándares para una inteligencia artificial generativa más segura

Empresas chinas como Baidu, Tencent y Ant, junto con empresas estadounidenses como NVIDIA, Microsoft, Meta, Google, Amazon y OpenAI, están colaborando en la creación de un estándar global. Su objetivo es establecer un marco que garantice un desarrollo seguro de la inteligencia artificial generativa para usuarios y empresas. La cooperación entre estas empresas líderes en tecnologías de IA generativa y modelos de lenguaje es un paso positivo en el campo.

En un evento de la Conferencia de las Naciones Unidas para la Ciencia y la Tecnología, los expertos de estas compañías presentaron dos documentos que resumen sus esfuerzos hasta la fecha.

Esta colaboración no se limita a un único estándar; de hecho, están trabajando en dos estándares simultáneamente. El primero se centrará en la IA generativa en general, mientras que el segundo se enfocará específicamente en los grandes modelos de lenguaje.

Recientemente, en un evento celebrado en Ginebra (Suiza), los expertos de estas compañías presentaron dos documentos que detallan los avances realizados: «Estándar para el análisis y la validación de la seguridad de la inteligencia artificial generativa» y «Método de análisis de la seguridad de los grandes modelos de lenguaje».

Estos documentos son actualmente los únicos estándares globales que abordan específicamente la IA generativa y los grandes modelos de lenguaje. La colaboración directa entre expertos de las empresas que impulsan el desarrollo de estas tecnologías es alentadora. En 2023, China se convirtió en el primer país en regular la IA generativa y los servicios relacionados.

Aunque existen otros estándares internacionales, como la «Recomendación para la ética de la IA» de la UNESCO en 2021 y las recomendaciones propuestas por ISO en 2022 y 2023, ninguno se centra tanto en la seguridad de la IA generativa y los grandes modelos de lenguaje como los mencionados anteriormente. Esperamos que estos esfuerzos colaboren en el avance y seguridad del campo.

Imagen | Pavel Danilyuk

Más información | SCMP

En Xataka | El líder de NVIDIA se moja: ha fijado con mucha precisión la fecha en que estará lista la inteligencia artificial general